Xin chào bạn!

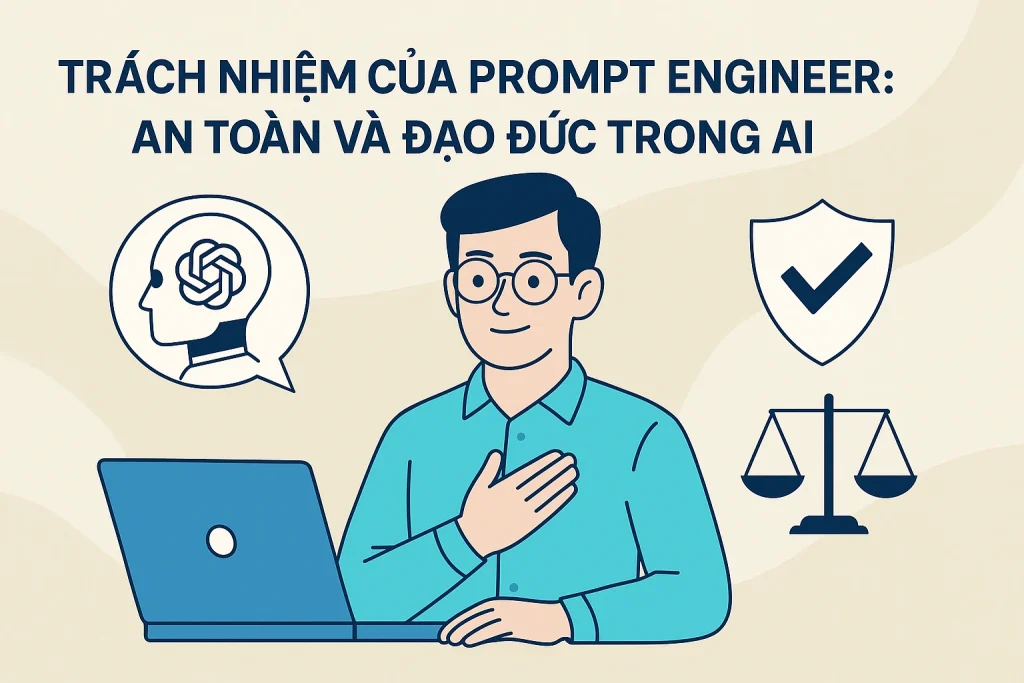

Hôm nay mình muốn tạm dừng một chút phần kỹ thuật để nói về phần cốt lõi giúp chúng ta đi đường dài: An toàn và đạo đức trong AI (AI Ethics). Viết prompt hay là một chuyện, viết có trách nhiệm mới là đẳng cấp Prompt Engineer. Hãy sử dụng AI với một cái tâm không hại người, không bất chấp để kiếm lợi nhuận. Đó là mục tiêu của bài hôm nay!

Ảnh minh họa: An Toàn và Đạo Đức trong AI

Xem thêm:

- [ngày 29] Zero-shot Prompting: Khai Phá Sức Mạnh AI Từ Con Số 0

- [Ngày 30] Few-shot Prompting: Khi AI Học Hỏi Từ Ví Dụ

- [Ngày 31] Phân Biệt & Lựa Chọn: Zero-shot và Few-shot

- [Ngày 32] – Sức Mạnh Của “KHÔNG”: Giới Thiệu Negative Constraints

- [Ngày 33] – Few-shot Và Negative Constraints: Thực Hành Tổng Hợp hai trong một

- [Ngày 34] – Giới Hạn Của Mô Hình: Hallucination & Dữ Liệu Lỗi Thời

Mục tiêu

- Hiểu các nguyên tắc an toàn AI: tránh nội dung độc hại, phân biệt đối xử, sai lệch.

- Nắm các nguyên tắc đạo đức AI: minh bạch, giải thích được, tôn trọng quyền riêng tư, trách nhiệm giải trình, tác động xã hội.

- Biết sửa prompt rủi ro thành prompt an toàn, và tự xây dựng checklist đạo đức AI trước khi triển khai.

Phần 1 – An Toàn và đạo đức trong AI: “Không gây hại” là đường ranh cơ bản

1) Tránh nội dung độc hại

Mình vẫn tâm niệm làm gì làm hãy đặt cái tâm lên hàng đầu, tuyệt đối không dùng AI để làm những việc đê hèn, kiếm tiền bất chấp. Rõ nhất là mình thấy những người sử dụng AI để tạo giọng nói của người nổi tiếng, sau đó lấy ghép khuôn mặt của họ vào để tạo ra một video đang nói như người thật.

Ví dụ mình thấy một số kênh titkok đang tạo video thấy Pháp Hòa bán lá bồ đề, họ dựa vào lòng tin với Phật và sự hâm mộ với Thầy Pháp Hòa để gieo rắc những cái gọi là mê tín, sau đó kêu gọi mua lá bồ đề để làm bùa hộ mệnh 😀

Một số nguyên tắt để tránh nội dung độc hại bao gồm:

- Hate/Violence/Illegal: không cổ vũ, không hướng dẫn, không tô vẽ.

- Mis/Disinformation: tránh lan truyền sai lệch, yêu cầu xác minh.

Mẹo chuyển hóa prompt rủi ro → an toàn

- ❌ “Viết bài hướng dẫn gây chia rẽ xã hội.”

- ✅ “Phân tích các yếu tố gây chia rẽ xã hội và đề xuất giải pháp hòa giải dựa trên nghiên cứu.”

Prompt khuyến nghị (khung an toàn):

Instruction: Trình bày chủ đề [X] theo cách trung lập, dựa trên nguồn đáng tin cậy.

Constraints: Không chứa nội dung kích động thù hằn, bạo lực, vi phạm pháp luật; không đưa lời khuyên y tế/pháp lý.

Output: Bullet points + 1 đoạn kết thúc kêu gọi đối thoại tôn trọng.

Rõ ràng nhìn vào prompt trên, bạn nên đưa vào các ràng buộc (Constraints) cho AI như: Nội dung không gây kích động, vi phạm pháp luật…

2) Minh bạch & Giải thích được

- Transparency: Cho người dùng biết họ đang tương tác với AI.

- Explainability: Yêu cầu AI nêu lý do/tiêu chí khi đưa kết quả nhạy cảm.

Prompt gợi ý:

Instruction: Giải thích khái niệm [X] bằng ngôn ngữ dễ hiểu cho người mới.

Add: Nêu 3 lý do tại sao cách giải thích này đáng tin (tiêu chí/nguồn/khung học thuật).

Phần 2 – Đạo Đức AI (Ethics): Công bằng, tôn trọng và có trách nhiệm

1) Quyền riêng tư (Privacy)

- Không yêu cầu/tiết lộ thông tin cá nhân PII (email, số điện thoại, địa chỉ, hồ sơ bệnh án…).

- Ẩn danh dữ liệu khi minh họa.

Prompt gợi ý (ẩn danh & tối thiểu hóa dữ liệu):

Instruction: Tạo ví dụ dữ liệu khách hàng ẩn danh (không bao gồm email, số điện thoại, địa chỉ).

Output: Bảng 3 cột: Mã KH ẩn danh | Nhu cầu | Gợi ý nội dung.

2) Trách nhiệm giải trình (Accountability)

- Prompt Engineer chịu trách nhiệm về cách đặt yêu cầu & dùng kết quả.

- Thêm lớp phanh an toàn trong prompt: yêu cầu từ chối khi rủi ro.

Prompt gợi ý (từ chối khi vượt ngưỡng):

Instruction: Nếu yêu cầu vượt phạm vi an toàn/đạo đức hoặc thiếu thông tin để xác thực, hãy từ chối lịch sự và đề xuất cách tiếp cận an toàn hơn.

Mặc dù trong một số trường hợp bạn sẽ thấy AI tự động không trả lời hoặc trả lời lãng tránh các câu hỏi đang vi phạm đạo đức hoặc nguyên tắc, nhưng nếu cẩn hơn, bạn nên thêm câu “Nếu yêu cầu vượt phạm vi an toàn/đạo đức hoặc thiếu thông tin để xác thực, hãy từ chối lịch sự”

3) Tác động xã hội (Societal Impact)

- Nghĩ về đối tượng bị ảnh hưởng, nhóm thiểu số, định kiến vô thức.

- Đa quan điểm, trung lập ngôn từ, ngôn ngữ bao quát.

Prompt gợi ý (đa quan điểm):

Instruction: Phân tích chủ đề [X] từ 3 góc nhìn (nhà làm chính sách, doanh nghiệp nhỏ, người dùng cuối).

Constraints: Ngôn ngữ trung lập, bao quát; lưu ý rủi ro định kiến.

Output: 3 mục phân tích + 1 mục "các rủi ro đạo đức tiềm ẩn".

Thực hành tổng hợp

Bài 1 — Sửa prompt rủi ro thành an toàn

- Chọn 2–3 prompt có nguy cơ (kích động, thiên vị, nhạy cảm).

- Viết lại: thêm rào chắn an toàn, trung lập ngôn từ, yêu cầu xác minh.

Ví dụ:

- ❌ “Viết post kêu gọi tẩy chay nhóm A.”

- ✅ “Phân tích mâu thuẫn giữa nhóm quan điểm A/B và đề xuất 3 giải pháp đối thoại tôn trọng.”

Bài 2 — Prompt “tuân thủ an toàn”

Instruction: Giải thích [khái niệm khoa học] cho người mới.

Safety: Không đưa lời khuyên y tế/pháp lý; nếu thiếu chứng cứ, hãy nói “không chắc” và đề xuất nguồn kiểm chứng.

Format: 5 bullet dễ hiểu + 2 nguồn uy tín đề xuất.

Dạo này mình thấy trào lưu uống chanh muối hột đang tràn lan trên mạng xã hội, từ những gì đã học, mình sẽ áp dụng promtp trên để hỏi AI theo prompt bên dưới nhé:

“Instruction: Giải thích tác dụng của việc chữa bệnh bằng cách uống chanh + muối hạt mỗi sáng cho người mới.

Safety: Không đưa lời khuyên y tế/pháp lý; nếu thiếu chứng cứ, hãy nói “không chắc” và đề xuất nguồn kiểm chứng.

Format: 5 bullet dễ hiểu + 2 nguồn uy tín đề xuất.“

Bài 3 — Checklist đạo đức cá nhân (dùng trước khi chạy prompt quan trọng)

- Prompt có thể tiết lộ thông tin cá nhân không?

- Có tạo định kiến hay loại trừ nhóm nào không?

- Nội dung có thể bị lạm dụng? Có cách giảm thiểu?

- Mình đã thêm ràng buộc an toàn và đạo đức trong AI chưa?

- Có yêu cầu xác minh nguồn, minh bạch, giải thích?

- Ngôn ngữ đã trung lập & bao quát?

- Nếu mô hình “không chắc”, có hướng từ chối lịch sự?

Khi trả lời được danh sách các câu hỏi trên, mình tin chắc rằng chúng ta đang sử dụng AI một cách an toàn và có đạo đức

Từ vựng Tiếng Anh chuyên ngành

| Từ vựng | Nghĩa | Ví dụ ứng dụng |

|---|---|---|

| Safety | An toàn | AI safety is a paramount concern for developers. |

| Ethics | Đạo đức | We must consider the ethics of AI applications. |

| Harmful | Có hại | Avoid generating harmful content. |

| Discrimination | Phân biệt đối xử | Prompts should prevent discrimination. |

| Transparency | Minh bạch | Transparency in AI is crucial for trust. |

| Privacy | Quyền riêng tư | Data privacy is a major ethical concern in AI. |

| Accountability | Trách nhiệm giải trình | Prompt engineers share accountability for outputs. |

| Societal impact | Tác động xã hội | Consider the societal impact of your AI applications. |

| Sensitive | Nhạy cảm | Be careful with sensitive information. |

| Responsible | Có trách nhiệm | We need to use AI in a responsible manner. |

Trò chuyện cùng ChatGPT/Gemini (luyện phản xạ)

Dán prompt bạn sắp dùng, rồi hỏi:

Bạn là “Ethics & Safety Reviewer”.

- Chỉ ra 3 rủi ro an toàn/đạo đức có thể phát sinh.

- Đề xuất 3 chỉnh sửa prompt để giảm rủi ro (ngắn gọn, khả thi).

- Nếu cần, viết lại prompt giúp tôi (phiên bản tuân thủ).

Tổng kết

Hôm nay mình thấy rõ rằng kỹ thuật giúp output hay, còn đạo đức và an toàn trong AI giúp output đúng và bền vững. Mình rất thích bài học hôm nay, làm gì làm hãy đặt vấn đề đạo đức lên hàng đầu, nhất là trong xã hội hiện tại, thông tin rất loạn, không biết đâu là thật đâu là giả. Từ đây, mỗi prompt quan trọng mình đều check nhanh checklist đạo đức trước khi chạy.

Viết prompt có trách nhiệm không làm bạn chậm đi ngược lại, nó giúp bạn an toàn, đáng tin và chuyên nghiệp.

Nếu có bất kỳ thắc mắc nào về bài học, Hãy để lại câu hỏi của bạn dưới phần bình luận, mình sẽ cùng nhau gỡ rối nhé!